문과생이 털어본 영상조작 AI ‘딥페이크’

이 글을 읽으면

진짜 같은 가짜 동영상 딥페이크(Deepfake)를

재밌게 알아보실 수 있습니다.

이전 편 <바둑왕 AI, 스타크래프트 2 정복하다?!> 를 읽어보시지 않았다면

이 링크를 확인해 주세요!

이 영상이 조작이라고?! : 충격과 공포, 딥페이크(Deepfake)

“상상해 보시죠. 수십억 명분의 도난당한 데이터, 그들의 모든 비밀, 그들의 삶, 그들의 미래를 완전히 컨트롤할 수 있는 한 사람을요.”

이 말을 페이스북 CEO 마크 저커버그가 했다면 어떨까요?

2016년 미국 대선 당시 페이스북 회원 8700만 명의 개인정보가 한 영국 데이터 분석업체에 유출된 적 있습니다. 이 데이터가 당시 대선후보였던 트럼프 진영에 흘러간 사실이 작년에 밝혀졌고, 지금까지도 페이스북은 개인정보 유출과 관련된 많은 문제를 일으켜 비난받고 있는데요. 이런 상황에서 저런 영상을 찍어 올린 건 자폭이나 마찬가지입니다.

물론! 이 영상은 저커버그가 직접 찍어 올린 게 아닙니다. 딥페이크(Deepfake) 기술이 활용된 가짜 영상이에요. 지난 6월 7일 한 인스타그램 계정에 업로드된 이 동영상은 원 출처에서만 10만 건이 넘는 조회수를 기록하고 있습니다.

혹시 영상이 가짜인 걸 처음부터 눈치챈 분이 계실까요? 합성에 쓰인 저커버그의 원본 영상 속 진짜 목소리는 딥페이크 영상의 목소리와 전혀 다릅니다. 하지만 목소리만으로 ‘이 영상은 조작됐어!’ 하기엔 영상이 너무 진짜 같지 않나요…?! ‘AI가 인간을 지배하는 날이 오면 어떡하지’ 보다 ‘딥페이크가 만든 가짜 영상에 낚이면 어떡하지’가 더 현실적인 걱정인 듯합니다.

딥러닝으로 동영상 조작의 새 시대를 연 딥페이크

(딥페이크의 활용 사례를 보여주는 영상)

딥페이크는 딥러닝의 ‘딥’에 ‘페이크’가 더해진 이름 그대로 인공지능을 통해 진짜처럼 보이는 가짜 영상을 만드는 기술입니다. 원본 영상의 얼굴을 합성할 대상의 얼굴로 바꿔치기할 수 있어요.

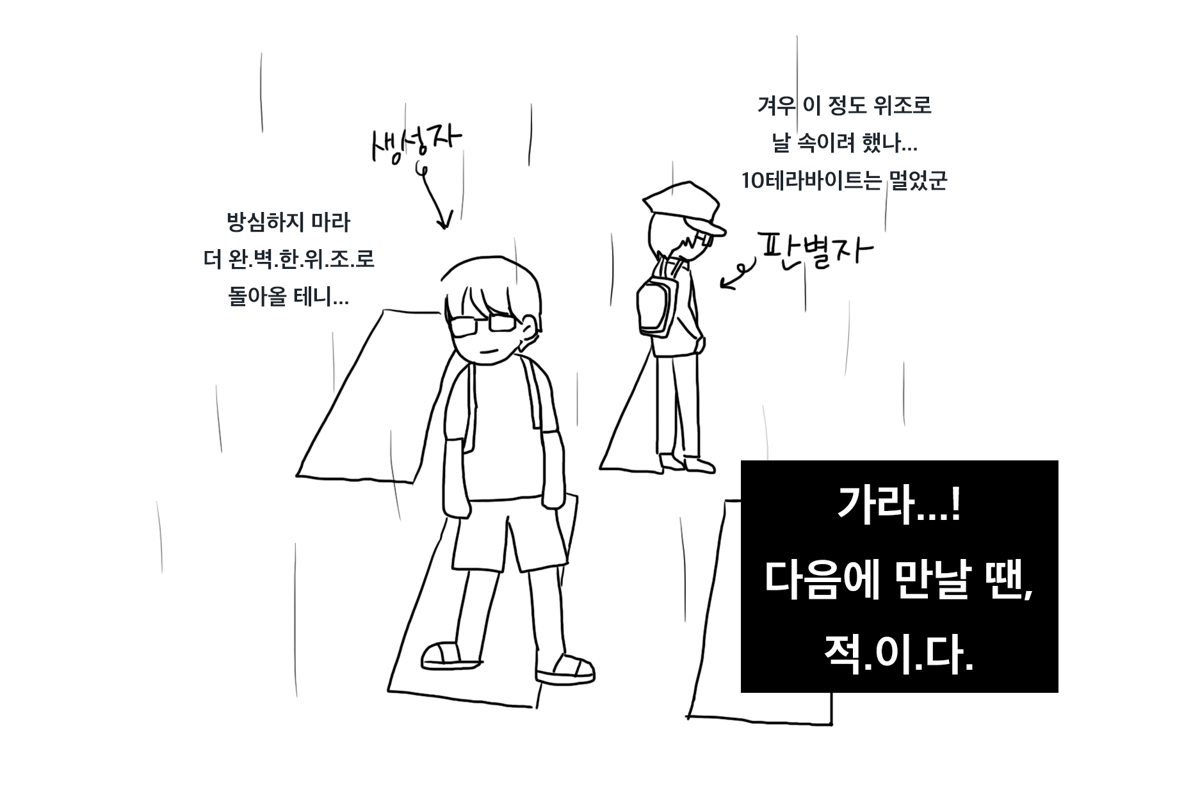

딥페이크는 GAN(Generative Adversarial Network, 생성적 적대 신경망)에 의해 가능해졌습니다. 2014년 이안 굿펠로우의 논문에서 발표된 GAN은 가짜 이미지를 만드는 ‘생성자(generator)’와 그 이미지가 진짜인지 가짜인지 알아내는 ‘판별자(discriminator)’가 서로 ‘적대적'으로 경쟁하며 이미지를 ‘생성’하는 기술이기에 생성적 적대 신경망이라는 이름이 붙었는데요.

여기서 ‘생성자’를 화폐 위조범, ‘판별자’를 위조범 잡아내는 경찰로 생각해 보면 간단합니다. 화폐 위조범이 가짜 화폐를 만들면 경찰이 가짜인지 알아내고, 그럼 화폐 위조범은 경찰이 알아낸 수법을 피해 더 정교해진 가짜 화폐를 만드는 식입니다. 이런 쫓고 쫓기는 경쟁을 통해 경찰, 아니 누구든 파악하기 어려운 진짜 같은 가짜 이미지를 만드는 게 GAN이죠. 이미지 말고도 다양한 데이터를 생성해낼 수 있고요.

이런 최신 기술이 활용된 딥페이크 영상은 생각보다 자연스럽고 생각 이상으로 만들기 쉽습니다. 2018년 공개된 PC용 애플리케이션 ‘페이크앱(FakeApp)’은 마음만 먹으면 얼마든지 무료로 다운받을 수 있고요. 페이크앱 사용 튜토리얼은 물론 더 자연스러운 영상 합성을 위한 간단한 팁까지 인터넷에 널려 있습니다.

(오바마가 합성된 영상)

이렇게 높은 접근성 때문인지 딥페이크를 악용하는 사례도 쏟아지고 있습니다. 할리우드 스타부터 우리나라 아이돌까지 수많은 연예인들의 얼굴이 포르노에 합성돼 ‘유출영상’이라는 타이틀을 달고 공유되는 것이 사회적 문제로 자리 잡았고요. 앞서 첨부한 오바마, 마크 저커버그의 사례처럼 정치인이나 각계 명사들의 평판을 떨어뜨리기 위해 조작된 영상들도 꾸준히 올라오고 있습니다.

인공지능 영상조작단 : 딥페이크와 그 친구들

딥페이크는 아직 완벽하지 않습니다. 합성된 영상을 자세히 보면 목과 얼굴색이 다르다거나, 다른 부분에 비해 합성된 얼굴 부분의 영상이 흐릿한 게 티가 나죠. 합성된 영상에서 인물의 눈 깜빡임이 적다는 특징을 잡아내 영상의 진위 여부를 가릴 수도 있습니다. 글의 처음에서 소개했던 마크 저커버그 영상도 사실 목소리가 전혀 달랐듯 음성으로도 합성 여부를 알아챌 수 있고요.

하지만 딥페이크의 이런 허점들은 언젠가 보완될지 모릅니다. 찰떡궁합을 자랑할 친구들이 세상의 빛을 볼 준비를 하고 있거든요.

영상에서 특정인의 목소리로 그가 하지 않은 말을 자연스럽게 위조할 수 있는 기술이 연구 단계에 있고(Text-based Editing of Talking-head Video)

사진 단 한 장으로 말하는 것처럼 움직이는 얼굴을 만드는 기술도 존재합니다(Few-Shot Adversarial Learning of Realistic Neural Talking Head Models). GAN이 워낙 핫한 영역이다 보니 더 놀라운 논문들이 계속 발표될 전망이고요.

인공지능 대 인공지능, 승자는?

창이 있다면 방패도 만들어져야죠. 미국 국방성의 연구조직 DARPA(Defense Advanced Research Projects Agency)를 비롯, 다양한 단체에서 딥페이크 등으로 조작된 영상과 사진의 진위를 알아내는 방법을 연구 중입니다. 이달 14일 어도비(포토샵 개발사)와 UC 버클리에서는 AI로 사진 속 얼굴이 편집되었는지를 찾아내는 방법을 개발했다는 소식을 전하기도 했고요.

조작하는 인공지능과 조작을 알아내는 인공지능의 대결이 치열해지는 지금, 사람들은 자나 깨나 조작 조심에 꺼진 영상도 다시 봐야겠습니다. 특히 페이스북이나 인스타그램에 돌고 있는 영상들을 주의해야겠어요. 인스타그램은 저커버그 조작 영상의 존재를 알고 있지만 ‘업로드한 정보가 사실이어야 한다는 규정은 없다’는 이유로 삭제하지 않겠다고 합니다.

3줄요약

- 딥러닝 기술을 이용해 조작된 딥페이크(Deepfake) 허위 영상이 나날이 늘어 가고 있습니다.

- 딥페이크를 가능하게 한 딥러닝 기술 GAN(Generative Adversarial Network, 생성적 적대 신경망)은 진짜 같은 가짜 데이터를 만드는 데 훌륭한 성능을 보입니다.

- 딥페이크 영상을 식별해낼 방법도 연구되고 있지만, 조작을 돕는 기술들도 계속해서 발전하고 있습니다.

더 읽어볼 자료

- 인공지능의 데이터 조작에 대해 더 자세히 알아보고 싶다면? <How do we work together to detect AI-manipulated media?>, WITNESS

- 딥러닝이 낯설다면? <딥러닝 라이즈 : 알파고는 하루아침에 나오지 않았다>, 문과생이 털어보는 AI 이야기

* AI에 대해 궁금한 점이 있다면 언제든지 댓글 남겨주세요. 비전공자(=저)도 이해할 수 있는 재미있는 주제라면 조사 후 다루어 보겠습니다:)