문과생이 털어보는 AI 이야기 #1

이 글을 읽으면

요즘 핫한 인공지능이 어떤 과정을 거쳐 발전되었는지

비전공자 수준에서 쉽고 재미있게 이해하실 수 있습니다:)

인공지능=AI=알파고=?

인공지능(Artificial Intelligence, AI)은 ‘인공+지능’, 즉 인간의 지능을 본따 만든 것이라고 합니다. 왜 굳이 기계가 인간의 지능을 따라 해야 할까요? 인공지능이 쓰이는 곳이 워낙 다양하다 보니 쓸모 있는 기술이구나 싶긴 한데, 그렇게 좋은 걸 왜 이제야 적극적으로 활용하는 걸까요.

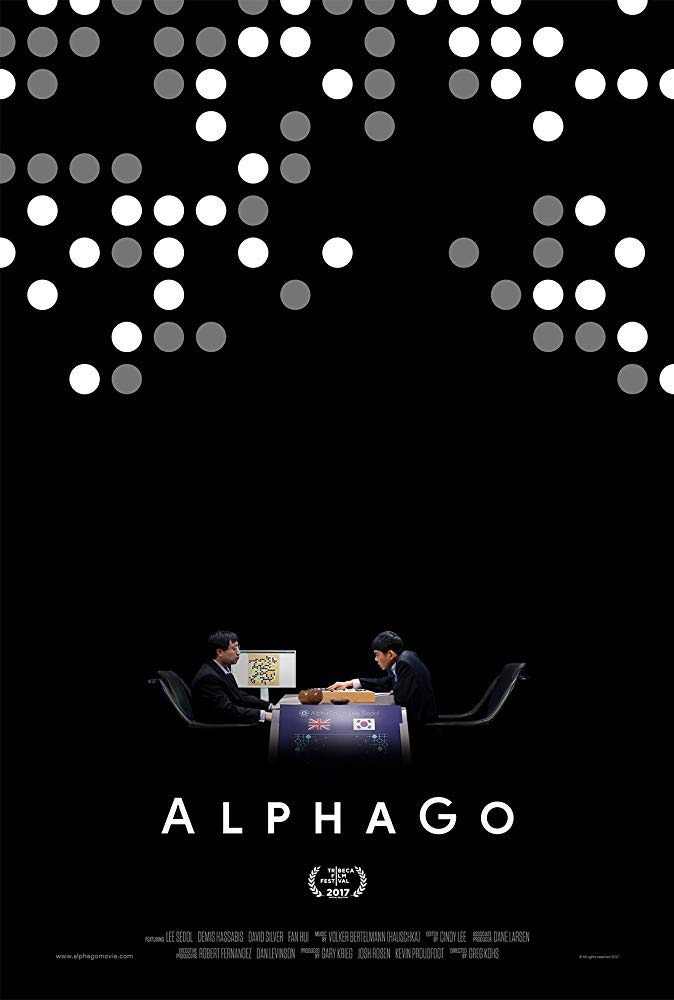

‘알파고가 이세돌을 이겼던 2016년부터 인공지능을 여기저기에 접목한다는 말이 많아진 것 같은데, 그럼 원인은 알파고?’

마침 지나가던 AI 전문가를 붙잡고 다짜고짜 질문을 던졌습니다.

“표현하는 방식은 시대마다 다르지만, 인공지능은 요즘 새로 나온 개념이 아니에요. ‘인간이 하는 일을 기계도 할 수 있을까?’ 하는 생각은 알파고 이전에도 당연히 있었어요. 18세기 후반에만 해도 태엽으로 돌아가는 인형이 그림도 그리고, 음악도 연주도 하고 그랬고요.”

(실제 작동되는 영상을 유튜브에서 보실 수 있습니다)

“오… 신기하네요. 근데 이건 요즘 말하는 인공지능이랑 좀 다른 것 같은데요. 이건 컴퓨터가 아니고 인형인데.”

“‘인간이 하는 일을 하는’ 인형이니까 저것도 인공지능의 범주에는 들어가죠. ‘인간처럼 행동한다’는 의미에는 정확하게 맞지 않을 수 있지만요.”

컴퓨터가 등장한 이후의 AI

생각해 보면 컴퓨터가 등장하기 전에도 사람을 닮은 기계, 혹은 사람을 돕는 기계는 존재했습니다. 고대 그리스 로마 시대에 이미 자동문이 있었다고도 하고요. ‘인공지능 개념은 언제부터 존재했을까’라는 질문에 답을 찾으려면 지구의 탄생까지 거슬러 올라가야 할 기세인데요.

요즘 우리가 말하는 ‘인공지능’이라는 용어가 생긴 순간부터 알아봅시다. 인공지능이라는 말은 1956년 여름 존 매카시가 개최한 다트머스 컨퍼런스에서 처음 사용되었습니다. 이 컨퍼런스는 인공지능 분야를 확립한 학술회의였고 몇 주 동안 수학, 전자공학, 인지과학, 물리학 등의 전문가들이 참여했습니다.

이후 존 매카시는 인공지능 분야에서 사용되는 프로그래밍 언어 리스프LISP를 만들기도 했습니다. 이 언어를 사용하는 기계도 생겨났죠. 프로그래밍 언어라고 하니 이제 좀 ‘요즘 얘기하는’ 인공지능 같아 보이네요. 컴퓨터로 프로그래밍되는 인공지능요.

“존 내시도 왔었네요? <뷰티풀 마인드> 제 인생영환데. 대박.

잠깐, 인공지능 포럼이 열렸다는 건 그전부터 인공지능에 대한 이야기는 오갔다는 거잖아요?”

“<뷰티풀 마인드> 보셨으면 혹시 <이미테이션 게임>도 보셨나요? 거기 나오는 앨런 튜링이 2차 세계대전 때 독일군 암호를 해독하려고 프로그래밍 가능한 컴퓨터를 만들잖아요.”

(<이미테이션 게임>에서 앨런 튜링을 연기했던 베네딕트 컴버배치와 16세의 앨런 튜링)

군사용이어서 전쟁이 끝난 후 파기되는 바람에 미국의 애니악(1945)보다 늦게 알려졌지만, 최초의 연산 컴퓨터 ‘콜로서스’를 만든 앨런 튜링. 그는 1950년 우리 문과생들도 다 아는 그 ‘튜링 테스트’를 제시한 논문을 작성합니다.

논문 <계산 기계와 지능> 에서 튜링은 ‘기계가 생각할 수 있을까?’라는 화두를 던지는데요, 이 문제를 풀기 위해 ‘모방 게임(imitation game)’ 형식의 테스트를 진행하는 걸 제안합니다. 테스트를 진행하는 사람이 다른 방에 존재하는 기계와 텍스트로 대화를 나눈다고 가정합시다. 이때 사람이 자신과 대화하고 있는 상대를 또 다른 사람인지, 기계인지 판별하지 못한다면 컴퓨터는 튜링 테스트에 통과하는 것입니다.

한 가지 더. 이 논문은 ‘학습하는 기계’에 대한 예언으로 마무리됩니다. 학습하는 기계는 인간이 프로그래밍한 대로만 작동하는 게 아니라, 학습을 거쳐 스스로 프로그램을 바꿔나갈 거라고요.

앨런 튜링은 이 논문이 발표되고 4년 후 생을 마감했습니다. 그전까지 생물학의 수학적 기초에 관심을 가지고 있었다고 전해지는데요. 웬 생물학이냐고요? 지금부터 이야기할 AI 변천사를 살펴보면 앨런 튜링의 빅픽쳐에 소름이 쫙 돋을지도 모릅니다.

AI 연구의 두 가지 흐름 : 기호적 AI와 연결주의 AI

컴퓨터가 발명된 이후 인공지능 연구는 크게 두 방향으로 갈라집니다. 디지털 컴퓨터의 작동방식을 기반으로 연구를 진행한 기호적(Symbolic) AI와 인간 뇌의 정보처리과정에서 영감을 얻은 연결주의(Connectionism) AI인데요. 이 둘의 엎치락뒤치락 연구 성과를 따라가다 보면 인공지능의 역사를 조금은 이해할 수 있게 됩니다.

기호적 AI는 컴퓨터 작동 방식에 맞게 논리와 기호로 세계를 표현하는 데 초점을 맞췄습니다. 두뇌 구조와는 전혀 닮지 않았지만 컴퓨터 작동 방식으로도 충분히 인공지능을 구현할 수 있다는 논리였죠.

1950년대 말부터 1960년대 초까지는 기호적 AI가 승승장구했습니다. 체스를 두는 기계 ‘체커’, 최초의 자율주행차 중 하나인 ‘샤키’가 등장하니 ‘이런 식이면 기계한테 인간이 하는 일을 맡겨버릴 수도 있겠는데?’ 기대도 착착 쌓였고요. 미국과 영국 등 인공지능을 선도하던 나라에서 연구비도 팍팍 지원하던 좋은 시절이었습니다.

하지만 1970년에 접어들어 이 AI들은 한정적인 용도로밖에 사용할 수 없다는 게 점차 밝혀졌습니다. 체스 두는 기계가 체스를 둘 수 있는 지능으로 다른 일도 할 수 있겠지 기대했는데, 그 기계는 체스밖에 못 뒀던 거죠. 덕분에 연구비가 대폭 삭감되었고요.

1980년대 접어들어 인간 전문가의 지식을 꽉꽉 눌러 담아 필요할 때 꺼내 쓰는 전문가 시스템이 등장해 다시 살림살이 좀 나아지나 싶었는데, 기호적 AI를 이끌어가던 리스프 언어를 쓰던 리스프 기계의 성능이 상대적으로 나빠지는 바람에… 이쪽 AI 연구는 빙하기에 접어듭니다.

한편 연결주의 AI는 인간 뇌의 정보처리 과정에 집중합니다. 1943년 제안된 인공신경세포는 이름 그대로 뇌의 신경세포를 모방한 것이었는데, 특정 세기 이상의 값에 도달하면 0과 1로 정보를 처리한다는 개념이었죠. 단순해 보이지만 이런 인공신경세포 여럿이 상호 연결되어 있으면 복잡한 계산을 수행할 수 있을 거라고요.

그리고 몇 년 후, 생물학적 뇌가 학습을 할 수 있는 건 신경세포 하나하나의 기능이 엄청나서라기보다 신경세포 간의 연결과 연결의 강도가 큰 역할을 하기 때문이라는 이론이 나왔습니다. 어, 인공 신경망도 상호 연결로 작동하는 거였잖아요? 그렇게 이쪽 노선에는 연결주의라는 이름이 붙습니다.

(왼쪽은 의무교육과정 때 열심히 외웠던 뇌의 신경계 세포 뉴런, 오른쪽은 퍼셉트론)

이런 흐름에서 ‘퍼셉트론’이라는 인공신경망 이론이 등장한 것이 1958년입니다. 생물의 뇌 속 신경망에 반복적인 신호가 있을 때 세포들이 그 신호를 기억하는 ‘학습효과’가 있음을 파악, 이를 인공 신경망에서 비슷한 효과를 내도록 흉내 내는 방법을 찾아낸 게 퍼셉트론입니다. 뉴런의 역할 일부를 수행하도록 해 기계를 ‘학습’ 시킨 거죠.

인공 신경망 학습방식의 알고리즘도 계속 개선되며 희망적인 분위기였지만 1969년에는 인공신경망 퍼셉트론에 수학적으로 한계가 있다는 연구가 발표됩니다. 갑자기 분위기 싸해지고, 판세는 기호적 AI 쪽으로 기웁니다.

(왼쪽은 풀 수 있지만 오른쪽은 직선으로 풀 수 없는 XOR 문제여서 퍼셉트론으로 해결 불가)

하지만 모두가 ‘안 돼!’ 할 때 ‘될 걸?’ 하는 소신 있는 사람이 있게 마련이죠. 인공신경망을 꾸준히 파던 학자들에 의해 인공신경망의 문제가 하나둘씩 해결되었습니다. 기존의 퍼셉트론이 해결하지 못했던 문제도 신경망의 계층 수를 늘리고 이에 맞는 학습방법을 찾아가는 연구들을 통해 개선되어 갔고요.

그 와중에 컴퓨터 성능도 나날이 좋아져 신경망을 여러 개 연결한 다층 신경망에서도 빠른 연산이 가능해졌습니다. 인터넷의 등장으로 인공지능이 다룰 수 있는 데이터도 많아져 인공신경망 인공지능이 발전을 거듭하게 되었다고 합니다. 튜링이 이야기한 ‘학습하는 기계’를 구현하는 방법이 인공지능의 대세가 된 거죠.

“그리고 이런 흐름에서 혜성처럼 등장한 게 알파고예요.”

“잠깐, 데이터가 많아진 건 인공신경망 발전에 왜 중요한가요?”

“학습이 딥러닝을 활용한 알파고가 엄청난 바둑 실력을 가지게 된 중요한 이유인데, 인공신경망은 학습할 데이터가 충분해야 성능이 잘 나와요.”

“또 잠깐, 지금 딥러닝이라는 개념이 처음 등장한 것 같은데 이대로 설명 끝인가요?”

“당연히 아니죠. 이건 다음 편 예고였어요.”

3줄요약

- 1956년 '인공지능'이라는 용어가 처음 탄생했던 시기, 인공지능을 디지털 컴퓨터 작동방식으로 구현하겠다는 기호적 AI와 인간 뇌를 본따 구현하겠다는 연결주의 AI가 각축을 벌이고 있었습니다.

- 대세는 엎치락뒤치락 옮겨가다 인공신경망을 구현한 연결주의 AI 쪽으로 완전히 넘어왔습니다.

- 연결주의 AI의 기조, '학습하는 기계'라는 아이디어를 제시한 튜링은 어마무시한 천재였습니다.

문과생의 깨달음

- 인공신경망이 성과를 보이기 시작하면서 그동안 한 우물 제대로 파던 연구자들은 대박 났잖아요. 인공신경망은 한계가 분명하다고 단정 지었다면 지금 같은 발전은 없었겠죠? 내가 옳다고 생각하는 신념을 꾸준히 밀고 가는 게 참 중요한 것 같아요!

- 존버는 과학인가 봅니다. 물론 그러다 망할 수도 있지만요.

여기 등장하는 사람은?

- 윤아 : 고등학교 전공은 영어, 대학교 전공은 국어. 뼛속까지 문과생인 AI 기술 스타트업 옴니어스 콘텐츠 마케터. 옴니어스 이름을 걸고 나오는 콘텐츠 전반을 담당합니다. 말버릇은 “문과생이 먹고 살기 넘나 힘들어요.”

- 재영 : AI 기술 스타트업 옴니어스 CEO. 카이스트에서 머신러닝 분야 박사 과정을 밟고 있던 중 옴니어스를 창업했습니다. 뒤돌아보면 항상 그곳에 있는 재영님, 종종 “파이팅!”을 외치고 사라지십니다.